Redes Neurais: Introdução ao MultiLayer Perceptron (MLP) a partir das limitações do Perceptron

934 views1014 WordsCopy TextShare

Fernando dos Santos

Neste vídeo apresento a limitação do Perceptron para aprender a classificar o operador XOR, haja vis...

Video Transcript:

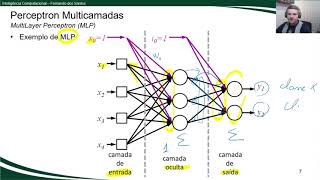

o próximo assunto que continua sendo redes neurais artificiais Mas agora nós avançamos um pouco mais aqui no tópico de redes neurais para falar desse segundo tipo de rede é uma evolução da primeira que nós vimos amada the multilayer perception E aí para introduzir esse assunto aqui era muito importante que vocês tivessem feito aquele aquela tentativa lá né de treinar o seu perceptível para fazer aquele operador Jor pelo seguinte aqui eu só mostrei o mesmo mesmo slides exercícios né aqui eu pedir para vocês treinarem e se percebe Tron aqui para aprender o usando esses dados aqui

executar pelo menos três épocas esse treinamento aqui a intenção era que ela encontrasse valores dos pesos aqui para a cada uma das entradas de modo a reconhecer aprender a classificar corretamente essas a transferências operações lógicas aqui no shopping para quem respondeu lá tentou fazer fez uma planilha tentou responder chegou à seguinte conclusão eu pedi para você executar em por três apps treinamento e aí você vai uns notou que ao final da primeira época o final da segunda época é o final do terceiro época o treinamento e não avançou por exemplo ao final da primeira época

para cada uma das entradas que a gente apresentou houve um ajuste aqui nos pesos porém o ajuste acontecia para cada uma das entradas cada uma delas geravam o valor G aqui né é um erro Delta que era utilizado para atualizar os pesos e no final que apresentamos aqui a última entrada que era entrada quatro os pesos voltaram para ver os preços foram reajustados com base nesse nesse erro aqui mas voltaram trazer na segunda época aconteceu a mesma coisa para cada uma das entradas aconteceram aqui os os erros os pés e atualizados e no final Chegamos

aqui Voltamos para a estaca zero literalmente né os valores dos pesos e aí para cada época que você executar se você veria que isso ia acontecer que os pesos inicialmente seriam ajustados aqui dependendo da entrada mas no final nunca chegaria nunca chegou se não valor no conjunto aqui de valores de pesos capaz de gerar esses valores de erro Delta aqui ou seja a rede nunca conseguiria nunca conseguirá aprender a resolver o problema do short rede com apenas um neurônio certo e com outros neurônios também ela dificilmente conseguiria Porque que só que acontece aí a gente

começa a ver algumas limitações né A primeira grande limitação desse tal percepção isso é natural isso essa natureza dessa desse tipo de rede neural essa limitação isso acontece pelo seguinte essa nossa rede neural é super certo ele é considerado um separador linear de dados ou de respostas né na verdade de dados que daí serão classificados em respostas em classes né ele só funciona e só consegue aprender a classificar-se as suas classes são linearmente separáveis o que que seriam classes linearmente separáveis aqui eu tô dando um exemplo para dizer que ali eram é que separava a

gente tem que imaginar esses essas entradas nessa esses valores de entrada e de saída em alguma visualização gráfica por exemplo 2 para ser linearmente inseparável os seus dados de entrada e as suas classes quando quando você coloca esses dados de entrada num plano você tem que conseguir traçar uma linha e separa o que que é de uma determinada classe por exemplo o que que é mais um do que que é um dia de uma outra determinada classe por exemplo no caso do and a natureza do operador and permite que ele seja ele é linearmente separado

por exemplo no caso do and aqui olha para os valores x 1 x 2 né quando X1 é verdadeiro ou positivo ex2 também é verdadeiro O resultado é verdadeiro nos outros casos quando X1 é verdadeiro e o x 2 é falso ou X1 falso x 2 verdadeiros ou os dois valores falsos as duas entradas x falsos o valor de saída com a saída sempre o falso sempre menos um aqui certo isso caracteriza dados linearmente separáveis a gente consegue então traçar essa linha que separa os dados a mesma coisa acontece no caso do óleo só que

muda a posição dessa linha ela passa aqui sim só que a gente ainda consegue ter agrupamento consegue o que separam os grupos de classes aqui o que é mais um do que é menos um no caso do shor ele não é linearmente separado Olha só como é que fica o short não tem uma configuração Onde eu consigo a traçar uma linha que joga tudo que é resultado bolinha ou falsa que no caso é para um lado e tudo que é quadradinho o verdadeiro por outro lado não tem não consigo seu traçar uma linha aqui eu

vou ficar com quadradinhos e bolinhas de um lado e quadradinhos e bolinhas de outro né aqui também a mesma coisa Qualquer tentativa que eu faço aqui eu nunca vou conseguir ter um grupo de um lado e um grupo do outro Essa é a limitação do percentual a rede neural percebe Tron que aquela que tem é uma camada de entrada mais uma camada de saída esse tipo de rede só consegue lidar com problemas linearmente separáveis Qual que é a solução 3 a solução para isso é usar um tipo de rede neural e consegue extrapolar que ele

limite unidimensional de classificação dos dados que é chamado de um separador multidimensional de dados e aqui eu trago esse exemplo para você verificar que se você sai de um plano e entra no espaço 3D você consegue criar uma separação o e consegue colocar tudo que é verdadeiro ou quadradinho para um lado e tudo que é falso ou bolinha para outro lado certo a sua separação o seu separador ele é na verdade ele tem um outro aspecto tem um aspecto aqui de plano no caso de um espaço tridimensional esse separador multidimensional Essa é uma das redes

neurais que implementa esse para dor multidimensional é o tal do percebe Tron multicamadas

Related Videos

9:54

Redes Neurais: Conceito de MultiLayer Perc...

Fernando dos Santos

5,922 views

42:54

Redes neurais e multilayer perceptron - Au...

Diogo Cortiz

17,245 views

14:29

Como uma Rede Neural Aprende? Tutorial par...

Escola de Inteligência Artificial

71,929 views

18:32

Redes Neurais - A arquitetura da rede Mult...

UNIVESP

1,807 views

11:49

Redes Neurais: Visão geral do treinamento ...

Fernando dos Santos

2,773 views

34:46

#PYTHON MACHINE LEARNING (05): Avaliar des...

Python DS

2,101 views

11:07

Redes Neurais Artificiais #02: Perceptron ...

Machine Learning para humanos

9,681 views

15:07

Avaliação de Modelos Preditivos: Validação...

Fernando dos Santos

1,316 views

9:33

Avaliação de Modelos Preditivos: Validação...

Fernando dos Santos

2,956 views

10:19

Avaliação de Modelos Preditivos: Matriz de...

Fernando dos Santos

842 views

6:45

Avaliação de Modelos Preditivos: Validação...

Fernando dos Santos

937 views

24:46

Formulação do Problema dos Jarros para Apl...

Fernando dos Santos

399 views

32:22

Principais Exercícios de TIPAGEM SANGUÍNEA...

Pedro Henrique Reis

29 views

24:15

Estatística - Semana 4 - Revisão

TechTeoremas

22 views

12:55

Java: diferença entre println e printf (co...

Fernando dos Santos

3,764 views

24:29

Estatística CTH – 05/11/2024

Professor Abend

14 views

14:06

Buscas em Espaço de Estados: Resolução do ...

Fernando dos Santos

302 views

18:18

Aula 9 BCD, ASCII, UNICODE e portas lógicas

Cultivando Idéias

5 views

26:49

Divisibilidade

javierfurg

No views